![]()

เมื่อวันที่ 13 มีนาคม 2567 รัฐสภายุโรปได้อนุมัติ EU AI Act โดยกฎหมายดังกล่าว ได้กำหนดหลักการที่สำคัญหลายประการ

อาทิ มาตรการที่เหมาะสมสำหรับการใช้ปัญญาประดิษฐ์ทั่วไป (General-purpose AI) ข้อจำกัดในการใช้ข้อมูลชีวภาพเพื่อการระบบระบุตัวตนโดยหน่วยงานบังคับใช้กฎหมาย ข้อห้ามการให้คะแนนทางสังคม และระบบปัญญาประดิษฐ์ที่ใช้ในการจัดการหรือหาประโยชน์จากช่องโหว่ของผู้ใช้ และสิทธิของผู้บริโภคในการร้องเรียนและสิทธิในการได้รับคำอธิบายจากการประมวลผลโดยระบบปัญญาประดิษฐ์ เป็นต้น

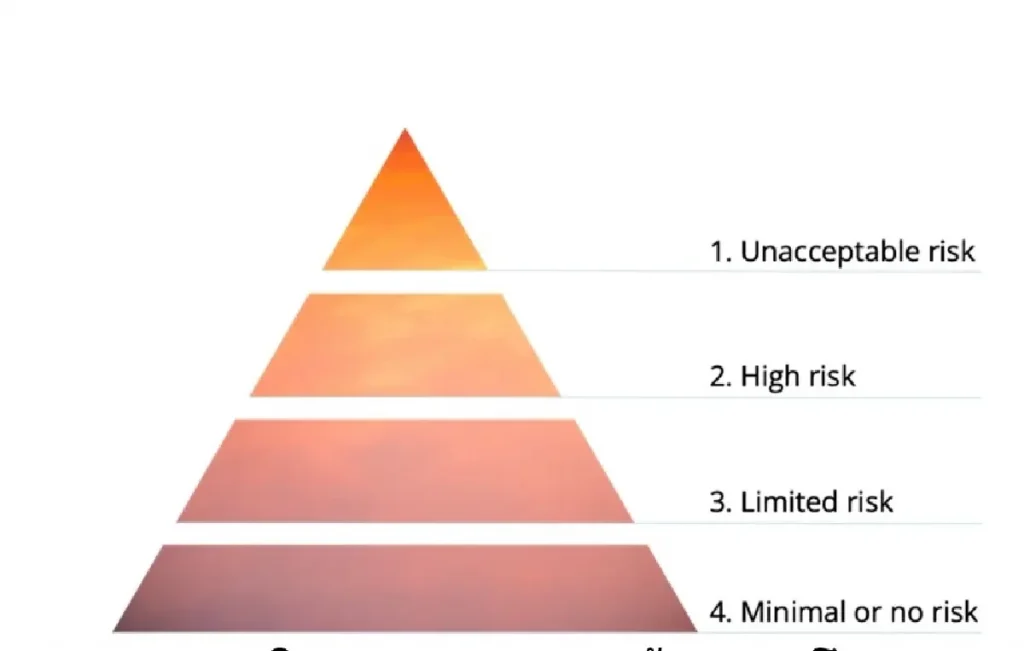

EU AI Act มีจุดมุ่งหมายเพื่อปกป้องสิทธิขั้นพื้นฐาน ประชาธิปไตย หลักนิติธรรม และความยั่งยืนด้านสิ่งแวดล้อมจากระบบปัญญาประดิษฐ์ที่มีความเสี่ยงสูง ส่งเสริมนวัตกรรมและสร้างยุโรปให้เป็นผู้นำในสาขานี้ กฎระเบียบดังกล่าวกำหนดพันธกรณีสำหรับระบบปัญญาประดิษฐ์ โดยพิจารณาจากความเสี่ยงที่อาจเกิดขึ้นและระดับผลกระทบ

โดยจำแนกระบบปัญญาประดิษฐ์ตามระดับความเสี่ยงไว้ 4 จำพวก ได้แก่ กลุ่มที่ไม่อาจยอมรับได้ ความเสี่ยงสูง ความเสี่ยงจำกัด และความเสี่ยงต่ำ โดยระบบปัญญาประดิษฐ์ที่ไม่อาจยอมรับความเสี่ยงได้นำมาซึ่งข้อห้ามการใช้ระบบปัญญาประดิษฐ์ (Prohibited Artificial Intelligence Practices) ในกรณีดังต่อไปนี้

1. การดำเนินการที่เกี่ยวกับจิตสำนึก มีเจตนาบิดเบือนหรือหลอกลวง

2. การใช้ประโยชน์จากความเปราะบาง (อายุ ความทุพพลภาพ สถานะทางสังคม/เศรษฐกิจ)

3. การจัดหมวดหมู่ข้อมูลชีวภาพตามลักษณะข้อมูลที่มีความละเอียดอ่อน

4. การให้คะแนนทางสังคมที่นำไปสู่การเลือกปฏิบัติที่ไม่เป็นธรรม

5. การระบุตัวตนด้วยข้อมูลชีวภาพแบบเรียลไทม์ในที่สาธารณะโดยหน่วยงานบังคับใช้กฎหมาย

6. การประเมิน/คาดการณ์ความเสี่ยงทางอาญาโดยอิงจากการทำโปรไฟล์

7. การสร้างฐานข้อมูลการจดจำใบหน้าจากข้อมูลอินเทอร์เน็ต/กล้องวงจรปิด

8. การอนุมานอารมณ์ในที่ทำงานหรือสถาบันการศึกษา

อย่างไรก็ตาม ข้อห้ามการใช้ระบบปัญญาประดิษฐ์ดังกล่าวอาจจะมียกเว้นได้ในบางกรณี อาทิ การระบุตัวตนด้วยข้อมูลชีวภาพแบบเรียลไทม์ในที่สาธารณะโดยหน่วยงานบังคับใช้กฎหมายนั้นแม้โดยหลักการแล้วเป็นสิ่งต้องห้าม แต่ก็อาจยกเว้นในสถานการณ์ที่มีการระบุรายละเอียดการดำเนินการอย่างครบถ้วนและจำกัดขอบเขต

และเมื่อเป็นไปตามมาตรการป้องกันที่เข้มงวด เช่น การใช้งานมีการจำกัดทั้งในด้านเวลาและขอบเขตทางภูมิศาสตร์ และได้รับอนุญาตจากศาลหรือหน่วยทางปกครองครองโดยเฉพาะ การใช้งานดังกล่าวอาจรวมถึงการค้นหาเป้าหมายของผู้สูญหาย หรือการป้องกันการโจมตีของผู้ก่อการร้าย การใช้ระบบดังกล่าวหลังการเกิดเหตุการจริงถือเป็นกรณีการใช้งานที่มีความเสี่ยงสูง จึงต้องได้รับอนุญาตจากศาลและมีความเชื่อมโยงกับความรับผิดทางอาญาอย่างเคร่งครัด

การใช้ระบบปัญญาประดิษฐ์มีความเสี่ยงสูง (Obligations for high-risk systems)

บทบัญญัติส่วนมากของ EU AI Act เป็นข้อกำหนดในส่วนที่เกี่ยวข้องกับระบบปัญญาประดิษฐ์มีความเสี่ยงสูง โดยกฎหมายกำหนดหน้าที่ที่ชัดเจนสำหรับการใช้ระบบปัญญาประดิษฐ์ดังกล่าวหลายประการ เนื่องจากการใช้อาจจะเป็นอันตรายต่อสุขภาพ ความปลอดภัย สิทธิขั้นพื้นฐาน สิ่งแวดล้อม ประชาธิปไตย และหลักนิติธรรม

โดยตัวอย่างการใช้ระบบปัญญาประดิษฐ์มีความเสี่ยงสูง ได้แก่ โครงสร้างพื้นฐานที่สำคัญ การศึกษาและการฝึกอบรมสายอาชีพ การจ้างงาน บริการภาครัฐและเอกชนที่จำเป็น (เช่น การสาธารณสุขและการธนาคาร) ระบบบางอย่างในการบังคับใช้กฎหมาย การจัดการการย้ายถิ่นฐานและการจัดการคนเข้าเมือง ความยุติธรรมและกระบวนการประชาธิปไตย (เช่น การมีอิทธิพลต่อการเลือกตั้ง)

การใช้ระบบดังกล่าวจะต้องมีระบบและกระบวนการในการบริหารความเสี่ยง รักษาบันทึกการใช้งาน มีความโปร่งใสและถูกต้อง การควบคุมดูแลโดยมนุษย์ (human oversight) ความถูกต้องและความมั่นคงปลอดภัยทางไซเบอร์ และกำหนดให้ประชาชนมีสิทธิยื่นเรื่องร้องเรียนเกี่ยวกับระบบระบบปัญญาประดิษฐ์และมีสิทธิได้รับคำอธิบายเกี่ยวกับการตัดสินใจโดยระบบปัญญาประดิษฐ์ที่มีความเสี่ยงสูงซึ่งส่งผลต่อสิทธิของตน

ข้อกำหนดด้านความโปร่งใส (Transparency requirements)

General-purpose AI (GPAI) และโมเดล GPAI ที่ใช้ต้องเป็นไปตามข้อกำหนดด้านความโปร่งใส รวมถึงการปฏิบัติตามกฎหมายลิขสิทธิ์ของสหภาพยุโรป โดยผู้พัฒนามีหน้าที่ต้องเผยแพร่ชุดข้อมูลโดยละเอียดของเนื้อหาที่ใช้ในการฝึกอบรมโมเดล GPAI ที่อาจก่อให้เกิดความเสี่ยงเชิงระบบจะต้องปฏิบัติตามข้อกำหนดเพิ่มเติม รวมถึงการดำเนินการประเมินแบบจำลอง การประเมินและการลดความเสี่ยงเชิงระบบ และการรายงานเหตุการณ์ (incident report) นอกจากนี้ รูปภาพ เสียง หรือเนื้อหาวิดีโอที่สร้างขึ้นหรือดัดแปลง (“deepfakes”) จะต้องมีป้ายกำกับอย่างชัดเจนอีกด้วย

การบังคับเชิงเขตแดนและบทกำหนดโทษ

EU AI Act มีผลใช้บังคับกับผู้ประกอบการที่อยู่นอกสหภาพยุโรปด้วย หากเข้าเงื่อนไขตามที่กฎหมายกำหนด อาทิ ผู้ให้บริการที่อยู่นอกสหภาพยุโรปและให้บริการเกี่ยวกับระบบปัญญาประดิษฐ์ในสหภาพยุโรป และผู้นำเข้าหรือผู้ส่งออกซึ่งผลิตภัณฑ์เกี่ยวกับระบบปัญญาประดิษฐ์ เป็นต้น โดยกฎหมายกำหนดความรับผิดไว้สูงสุดที่ร้อยละ 7 ของผลประกอบการทั่วโลก หรือไม่เกิน 35 ล้านยูโร แล้วแต่กรณีใดสูงกว่า

ผลจากสภาพบังคับนอกเขตแดนแห่งรัฐและค่าปรับที่สูงมาก ประกอบกับข้อกำหนดและเงื่อนไขเกี่ยวกับการจัดการตามที่กฎหมายกำหนดมีรายละเอียดจำนวนมาก และกำหนดให้มีหน่วยงานกำกับดูแลในแต่ละประเทศสมาชิก ดังนั้น กฎหมายฉบับนี้จึงมีโอกาสที่จะมีผลกระทบต่อผู้เกี่ยวข้องในห่วงโซ่อุปทานของระบบปัญญาประดิษฐ์ทั่วโลก

EU AI Act อยู่ในขั้นตอนการตรวจสอบของนักกฎหมาย-นักภาษาศาสตร์ขั้นสุดท้าย และกฎหมายยังต้องได้รับการรับรองอย่างเป็นทางการจากสภา (EU Council) อีกด้วย โดยจะมีผลใช้บังคับ 20 วันหลังจากการตีพิมพ์ในวารสารอย่างเป็นทางการ.

อ้างอิง ::

Artificial Intelligence Act: MEPs adopt landmark law,

บทความโดย ศุภวัชร์ มาลานนท์ มจธ. | ระวีวรรณ ขันติวิริยะพานิช DPOAAS

———————————————————————————————————————————————————————————

ที่มา : กรุงเทพธุรกิจออนไลน์ / วันที่เผยแพร่ 4 เม.ย.67

Link : https://www.bangkokbiznews.com/tech/gadget/1120754