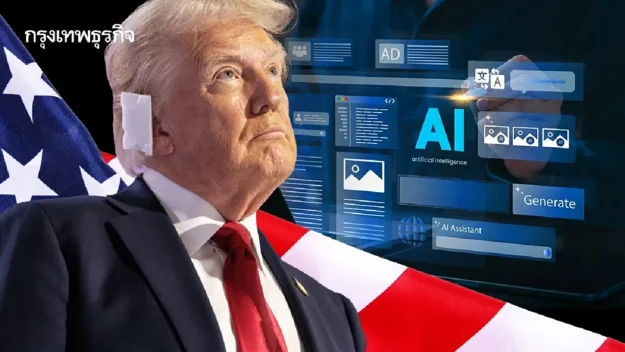

AI เติบโต – ไร้กรอบ? จับตาอนาคตเทคโนโลยีสหรัฐ หลังทรัมป์นั่งเก้าอี้ผู้นำ

![]()

ทิศทางเทคโนโลยีสหรัฐ หลัง ‘ทรัมป์-มัสก์’ ร่วมมือ คาดนโยบายด้านปัญญาประดิษฐ์ (AI) จะผ่อนคลาย ผู้บริหารเทคฯ ยักษ์ใหญ่แห่สนับสนุน แม้สังคมห่วงขาดการกำกับดูแล การกลับมาของ “โดนัลด์ ทรัมป์” ในฐานะว่าที่ประธานาธิบดีสหรัฐ คนที่ 47 ทำให้หลายฝ่ายจับตามอง “ทิศทางนโยบายด้านเทคโนโลยี” ที่จะเกิดขึ้นในอีก 4 ปีข้างหน้า โดยเฉพาะอย่างยิ่งในแง่นโยบายการกำกับดูแลด้านปัญญาประดิษฐ์ (AI) ที่คาดว่าจะผ่อนคลายลงอย่างมีนัยสำคัญ ซิลิคอนวัลเลย์พลิกขั้ว ซีอีโอเทคฯ แห่สนับสนุนทรัมป์ ทันทีที่ผลการเลือกตั้งประกาศชัยชนะของทรัมป์ บรรดาซีอีโอของบริษัทเทคโนโลยียักษ์ใหญ่ต่างรีบส่งข้อความแสดงความยินดี ซึ่งแตกต่างจากท่าทีที่ระมัดระวังในการเลือกตั้งปี 2016 และ 2020 ผู้บริหารจาก Amazon, Apple, Google, Meta และ Microsoft ต่างโพสต์ข้อความสนับสนุนบนโซเชียลมีเดีย สะท้อนว่า พวกเขา “มีความหวัง” ที่จะฟื้นฟูความสัมพันธ์กับประธานาธิบดีคนใหม่ หลังจากที่พวกเขาเผชิญกับการตรวจสอบด้านการผูกขาดและการแข่งขันทางการค้าอย่างเข้มงวดในยุครัฐบาลไบเดน มาร์ก ซัคเคอร์เบิร์ก (Mark…